LA_TITO escribió: Creo que aquí solo se están enterando tres personas, las demás leemos, pero no comprendemos.

Es muy fácil Sagrario:

Dani pregunta por un método de interpolación eficiente y cómo utilizarlo. La interpolación es algo así como un "engorde" de información basado en un algoritmo (secuencia lógica de comandos) para en el caso que nos importa (el archivo fotográfico) dotar de más tamaño a una imagen (interpolación al alta) o menos tamaño (interpolación a la baja). La interpolación a la baja no lleva pareja una pérdida de calidad, ya que sobra en este caso información y queremos reducirla. El problema viene en la interpolación al alta, que es donde un sistema informático tiene que trabajar para "inventarse" píxeles utilizando unos patrones de similitud respecto a los píxeles adyacentes.

Lógicamente esta interpolación no nos va a dar necesariamente más detalle en nuestra imagen, sino una imagen más grande y con más píxeles. El aspecto como sabes es una pérdida de definición general unido a ese aumento de tamaño. Existen métodos... o mejor dicho, algoritmos de interpolación más eficientes que otros:

Interpolación por aproximación: Es uno de los métodos más antiguos. Se basa en obtener el promedio de valores de los 2 pixeles más próximos. La interpolación bilineal es una mejora de la anterior, promediando en este caso 4 pixeles adyacentes.

Interpolación bicúbica: Usada por programas como Adobe Photoshop o Paint Shop Pro es el método de interpolación considerado estándar (promedia 16 pixeles adyacentes). Photoshop además usa algunas variaciones como Interpolación bicúbica enfocada o Interpolación bicúbica suavizada que se basa en aplicar algunos cambios a la imagen final.

Interpolación en escalera (Stair Interpolation): Se basa en la interpolación bicúbica con la diferencia que se va interpolando en incrementos de un 10% en cada paso con respecto al anterior.

Interpolación S-Spline: Este método de interpolación determina el color de un pixel «desconocido» basándose en la totalidad de colores de la imagen, a diferencia que los métodos anteriores.

Interpolación Lanczos: Disponible de forma gratuita en IrfanView y en GIMP 2.3 y posteriores versiones, se basa en la calidad de la imagen y ofrece resultados muy similares al método Mitchell.

Interpolación Genuine Fractals: Por último, se utiliza el sistema de interpolación de Genuine Fractals que parece tener también unos resultados bastante aceptables.

También hemos hablado de la interpolación de color desde la matriz Bayer (demosaicing) que es otro concepto de interpolación que en este caso no hace la imagen más grande... sino que interpreta el color que falta por la limitación de la matriz... lo explico.

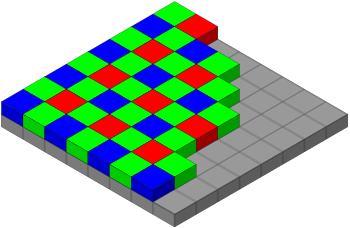

Cada fotodiodo (mal llamado píxel) del sensor de tu camara no esta preparado para interpretar un determinado color.... tan solo capta un valor de luminosidad (o sea que ve variaciones de luz). Pero a un determinado fotodiodo le podemos preparar para que sea sensible al verde.... o al rojo.... o al azul (pero nunca los tres a la vez). Ahì es donde entra a funcionar la matriz BAYER, que despliega una maya estratégica de filtros 50% de verdes, 25% de rojos y 25% de azul. Para la matriz Bayer los filtros verdes compondrán la luminosidad de la imagen, mientras que los rojos y azules darán el color. Como dije antes se sabe que el ojo humano está más preparado para captar el verde... de ahí esta distribución.

Seguidamente al revelar o interpretar la imagen devuelta por el sensor se interpola el color que falta para componer la imagen final. Es decir La eficiencia de los sensores digitales basados en la matriz Bayer (aquí entran los CMOS y CCD, práctimente la inmensa mayoría de las cámaras digitales) no es total, sino un tercio de eficientes de lo que debería ser un sensor IDEAL.

CONCLUSION: Los sensores digitales capturan un tercio del color real... el resto que falta se tiene que inventar.

Existe otro sensor patentado por SIGMA llamado Fóveon X3

Como se puede ver en este gráfico este sensor tiene otra arquitectura totalmente revolucionaria, lleva un triple filtrado que dependiendo de la longitud de onda de la luz deja pasar y-o absorbe el color para conseguir que el fotodiodo capture un valor de color real y no un canal separado.

¿PORQUÉ HE HABLADO DE PHOTOACUTE Y QUE TIENE QUE VER CON ESTO?

Phtoacute, como dije es un software que entre otras cosas, puede interpolar una imagen dotándola de una excelente resolución. La nitidez que consigue un sensor basado en matriz Bayer (u otra matriz... hay fabricantes que han patentado las suyas propias) es inferior a lo que "debería de ser" ya que ha sufrido una interpolación. Pero ¿y si completamos a lo bruto esa información perdida con otras muchas imagenes de la misma cosa?

Pues eso es lo que hace PhotoAcute, dota a la imagen de más resolución basado en un sistema relativamente simple (por lo menos en su concepto). Hacemos una foto con nuestra cámara a una resolución de 10-12 Mpx de un determinado motivo y la repetimos 3-4- o 5 veces. Lógicamente nuestra cámara debe estar montada en trípode y a ser posible activando la función de levantar el espejo para que las vibraciones sean las menos posibles. En teoría las fotos deben ser idénticas por lo menos a simple vista. Después el programa las alinea y hace encajar todo en su sitio (siempre hay una ligera variación entre tomas) para después completar con la información de todas las tomas las partes menos definidas de la toma original.

Esto lógicamente es un engorro, pero para cosas puntuales me parece muy interesante. Os animo a que lo probéis, y os maravilleis de toda la información que podría estar en nuestras fotos y por desgracia se pierde en el camino. De hecho tengo entenido que este tipo de sofware se usa en departamentos de policía científica para sacar más información de cámaras de seguridad por ejemplo.

Dani, mira este artículo:

www.rawness.es/algoritmos-de-interpolaci...-y-micro-43/?lang=es